智东西(公众号:zhidxcom)

编| 李水青

导语:“AI情感识别”没你想的那么神通,别被它误导。

智东西7月26日消息,近日,美国五名专家发表了一篇论文驳斥“根据表情识别情感”的方法论。这些专家耗时两年查阅1000多项研究,证明市面上的许多依托面部表情识别情感的算法缺乏充分的科学依据。

据称,这意味着包括微软、谷歌在内的许多公司的“情感识别算法”的原理可能并不严谨,如果被应用到招聘、医疗、安检等场景中,或对用户产生严重的误导作用。

▲美国五名专家发表了一篇论文驳斥“根据表情识别情感”的方法论

一、热门情感识别软件硬伤:皱眉≠愤怒

随着人工智能(AI)被广泛运用于人类决策中,许多研发者表示已经可以打造能解决感情问题的AI工具。

微软、亚马逊及IBM等科技公司都纷纷推广自家的“情感识别算法”。这些产品大多是基于面部表情识别人的感受,例如,如果人们皱眉、撅嘴就意味着生气等。

“情感识别算法”可以被应用到多种场景,比如求职平台软件可以通过自动监测“愤怒”情绪的算法系统,为招聘企业过滤一些情商不达标的候选人。

“一些公司号称他们已经完全可以通过算法识别情感,但是数据表明并非如此。它们的算法可以识别到皱眉,但这不等于检测到愤怒情绪。”美国东北大学心理学教授Lisa Feldman Barrett说。Barrett等五位科学家耗时两年,将其研究成果发表在论文《再论人类情感表达:从人类面部表情辨别情绪的方法论面临的挑战》中。(论文原名为:《Emotional Expressions Reconsidered: Challenges to Inferring Emotion From Human Facial Movements》)

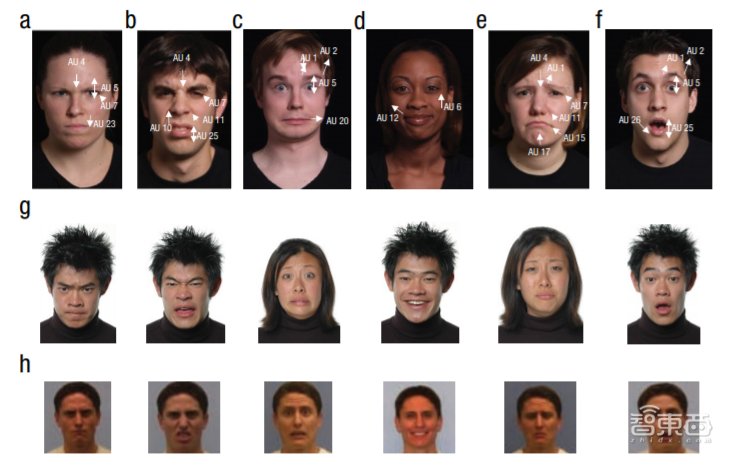

▲研究者使用面部动作编码系统(FACS)来描述成人的面部结构

二、耗时两年,查阅1000多项研究

该论文耗时两年,论文作者查阅了1000多项不同的研究。五位作者来自美国东北大学、格拉斯哥大学等机构,都是情感科学领域的不同理论阵营的杰出科学家。他们受美国心理科学委员会所托,仔细检查相关研究的证据。“起初,我们不确定是否能就数据达成共识,但我们最终做到了。”Barrett说。

研究表明,人类情绪的表达方式极其丰富复杂,很难靠简单的面部表情识别。

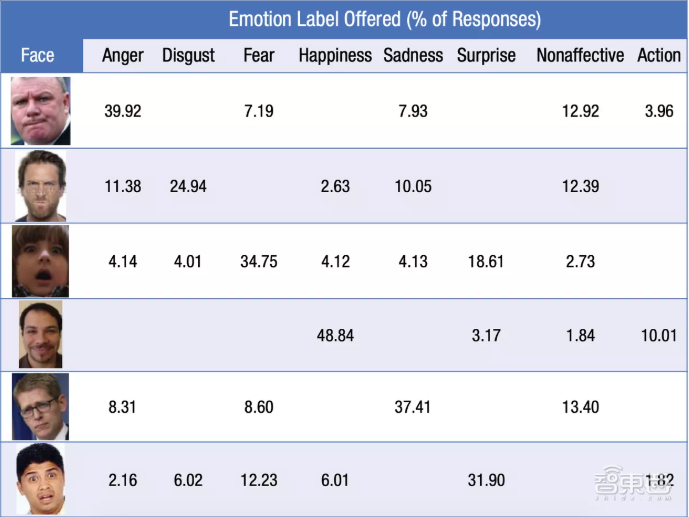

Barrett说:“数据表明,当人们生气时,在平均不到30%的时间里他们会皱眉。故皱眉不等于愤怒,皱眉只是‘愤怒’的众多表达方式之一。这意味着在超过平均70%的时间里,当人们生气了是不皱眉的。而且关键是,当他们不生气时,他们也会经常皱眉。”

因此,提供这类“情绪识别算法”的公司往往会误导消费者。

“你确定要以此为基础做决定吗?”Barrett说,“当你在法庭打官司,在医院等诊断或是在机场过安检,你愿意让那30%的概率来‘裁决’你吗?”

三、承认表情有用,也要考虑语言、情境

当然,按照社会约定俗称的习惯,人们会主动地使用表情来表达情绪。但是,当人们进行面对面互动时,并不会只从面部分析彼此的情绪,而是会通过着装、动作、语言等多种因素,联系个人经历、传统习俗、人际关系等多种背景信息。

该论文认为在情绪研究领域存在着各种各样的刻板印象。具体而言,它反驳的是“通过表情来获取情绪‘指纹’”的理论。这种理论源于20世纪60年代心理学家Paul Ekman的研究。

Barrett等学者表示,一些理论主张面部表情与情绪之间存在强相关性,这些理论的相关研究在方法上大多存在缺陷。例如,拿演员表情来说,演员常常被要求从有限的情绪中选择一种,如“愤怒”,进行表演,从而以某些方式把这种“愤怒”情感传达给观众。

▲当人们被要求按照自我理解做表现同种情绪的表情时,这些表情获得的AI判别结果差异很大

“虽然演员能选择的抽象情绪种类有限,但是这些情绪转化为直观的表达,就很复杂了。”Barrett说,“当一个演员要表达愤怒时,他可能会哭、会大喊、会笑或只是静静地坐着,然后思考着复仇计划。你能接受演员因为用“皱眉”表达愤怒而获得奥斯卡奖吗?相信很少有人爱看这种表演。

四、要考虑更多变量和变量的优先级

然而,这些人类情绪的微妙之处很少被“情感识别工具”的缔造公司承认。例如,微软在其相关产品的宣传中称,其AI情绪识别软件可以“根据面部表情来识别八大情绪”。

对此,相关公司常说,他们的分析是基于更多的数据信息,而不仅仅是面部表情。那么问题在于,它们的算法是是否对这些数据进行加权,以及如何做到变量权重平衡的?

据称,“情感识别”市场规模已达到200亿美元。业内领先公司之一Affectiva表示,它正在尝试收集更多情绪表达变量。例如,它推出了一种工具,能够通过结合表情和语音来综合衡量驾驶员的情绪。也有其他研究人员正在研究通过步态识别和眼动追踪来识别情感。

Barrett相信,通过更丰富的变量分析,在未来我们将能够更准确地识别情感。“我绝对相信这是可能的。”她说,“但这并不意味着我们不该阻止目前误导性技术的扩散。”

结语:情感识别“不简单”,变量可靠性最关键

当前一些“情感识别算法”选择变量的标准不是变量的“可靠性”,而是这个变量能不能被衡量。“情感识别产品”所用的机器学习是一种过于擅长寻找联系的技术,这可能会导致各种肤浅、甚至虚假的分析。

比如一些机构利用机器学习算法,通过分析保姆在社交网站的发帖,来洞察其“态度”,进而分析保姆态度和公司财报记录、预测股票价格的关系等等。

如果这类误导性的“情绪识别工具”被普及开来,我们可能会慢慢接受它并让它影响我们的社会人格成长历程。社会学家库利(Charles Horton Cooley )认为,来自外部的期待和评价是一面镜子,人类会依据“镜中我”来实施行动,以使自我符合外部的期待和评价。误导性的“情绪识别工具”像一面“哈哈镜”,当人们看到自己的表情被其线性的解释,人自己渐渐也就相信那是真的了。

Barrett说,或许该论文最大的价值在于让我们不要过于简单化地认识人类情绪。情绪的表达是多样、复杂和有情境的。

论文链接:https://journals.sagepub.com/stoken/default+domain/10.1177%2F1529100619832930-FREE/pdf

文章来源:The Verge