【阿里通义千问开源 320 亿参数模型】

通义千问开源其 320 亿参数模型 Qwen1.5-32B。

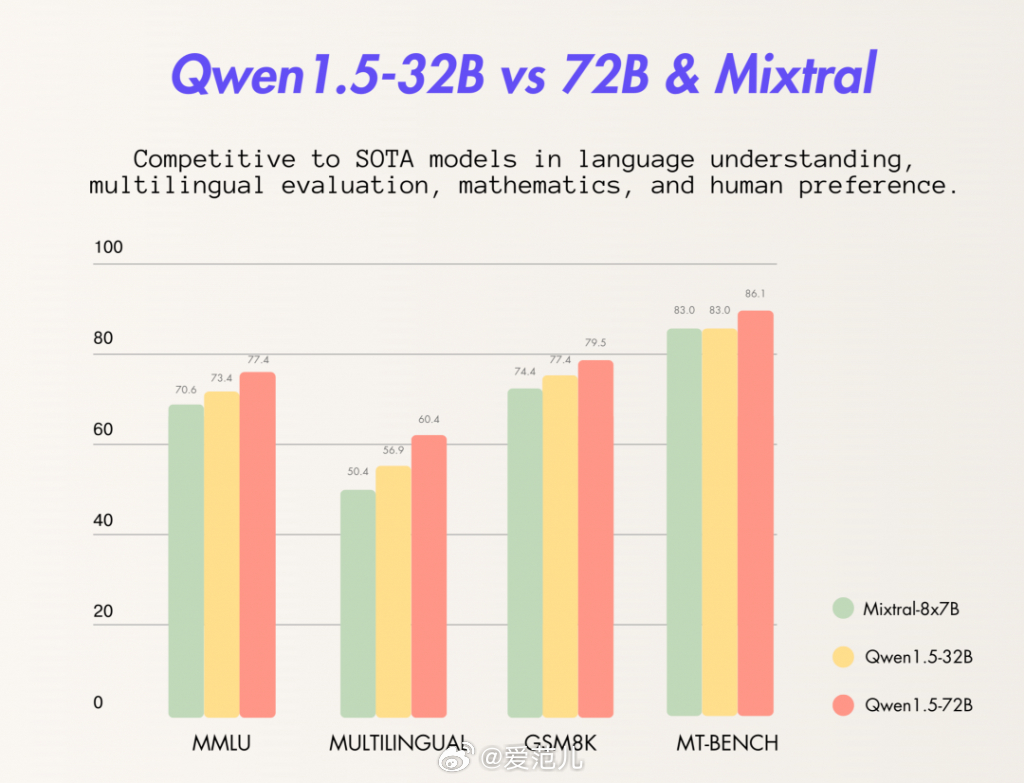

据介绍,这一模型旨在对标最先进的 30 亿参数模型所设定的性能基准,同时,也提升了 Qwen1.5-32B-Chat 对话模型的对话能力。Qwen1.5-32B 系列模型的内存占用比 72B 模型大幅减少,运行速度显著提升。

通义千问此前已开源 5 亿、18 亿、40 亿、70 亿、140 亿和 720 亿参数 6 款大语言模型。

【阿里通义千问开源 320 亿参数模型】

通义千问开源其 320 亿参数模型 Qwen1.5-32B。

据介绍,这一模型旨在对标最先进的 30 亿参数模型所设定的性能基准,同时,也提升了 Qwen1.5-32B-Chat 对话模型的对话能力。Qwen1.5-32B 系列模型的内存占用比 72B 模型大幅减少,运行速度显著提升。

通义千问此前已开源 5 亿、18 亿、40 亿、70 亿、140 亿和 720 亿参数 6 款大语言模型。