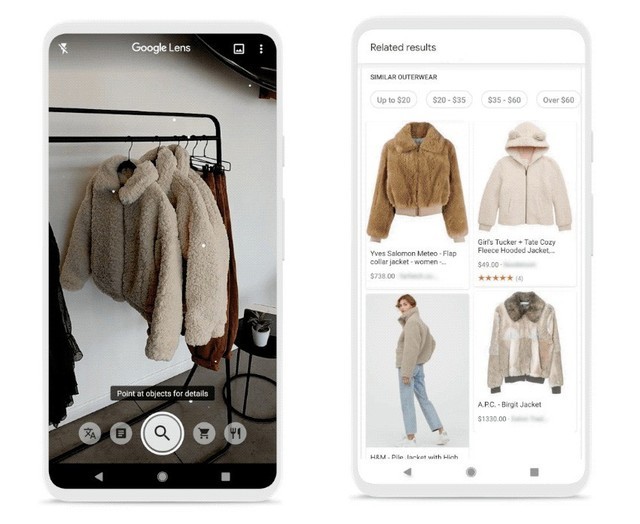

谷歌正在更新其视觉搜索工具Google Lens,加入新的人工智能驱动的语言功能。这次更新将让用户使用文字进一步缩小搜索范围。因此,举例来说,如果你拍了一张佩斯利衬衫的照片,以便使用Google Lens在网上找到类似的物品,你可以添加 ""具有这种图案的袜子 ""的命令,以指定你要找的服装。

此外,谷歌正在其iOS谷歌应用程序中推出一个新的 ""Lens模式 ""选项,允许用户使用搜索网络时出现的任何图像进行搜索。这将 ""很快 ""推出,但仅限于美国地区。谷歌还在桌面上的Chrome浏览器中推出了Google Lens,让用户在浏览网页时选择任何图片或视频,在不离开标签的情况下找到视觉搜索结果。这将 ""很快 ""在全球推出。

这些更新是谷歌最新推动的使用人工智能语言理解改进其搜索工具的一部分。Lens的更新是由该公司今年早些时候在I/O大会上公布的名为MUM的机器学习模型驱动的。除了这些新功能外,谷歌还在其网络和移动搜索中引入了新的人工智能驱动的工具。

Google Lens的变化表明,该公司并没有对这一功能失去兴趣,该功能一直显示出前景,但似乎更多的是作为一种新奇的东西吸引人。机器学习技术已经使物体和图像识别功能在基本水平上相对容易启动,但正如今天的更新所显示的那样,它们需要用户有一点技巧才能正常使用。不过,人们的热情可能正在回升--Snap最近升级了自己的扫描功能,其功能与Google Lens基本相同。

谷歌希望这些Lens的更新能把它的世界扫描AI变成一个更有用的工具。它举了一个例子:有人想修理自己的自行车,但不知道后轮上的装置叫什么。他们用Lens拍了一张照片,加上搜索文字 ""如何修理这个"",谷歌就会弹出结果,将这个装置识别为 ""脱轨器""。

与以往这些演示一样,谷歌提供的例子似乎简单而有帮助。但我们必须亲自尝试一下更新后的Lens,看看人工智能语言理解是否真的使视觉搜索不再只是一种花招。