买得越多

省得越多

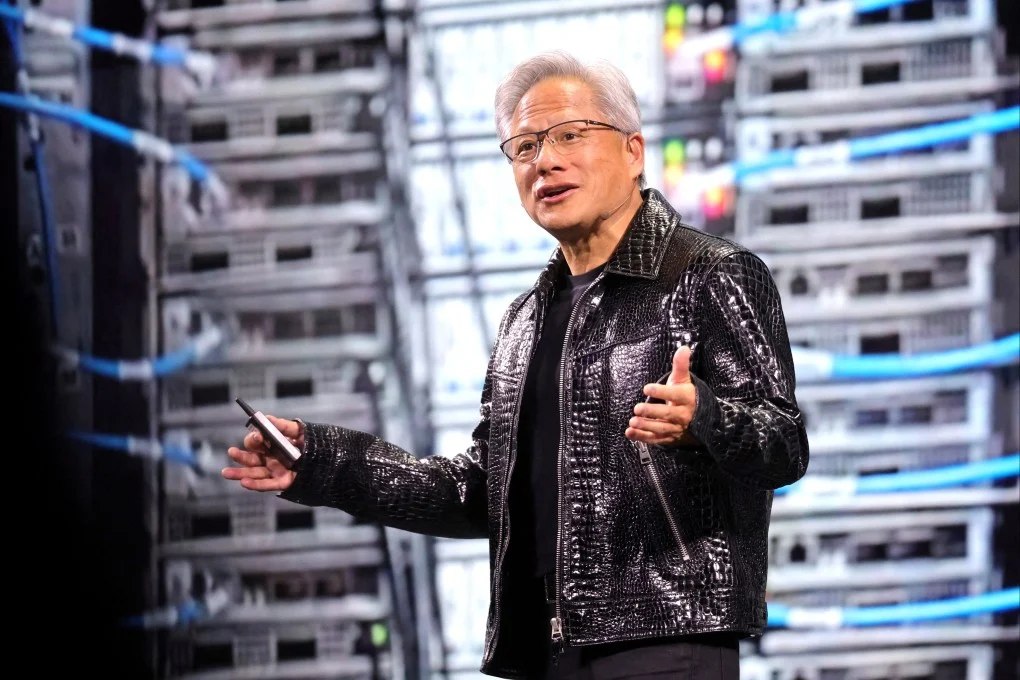

英伟达GTC大会已经成了AI界超级碗,没有剧本也没有提词器,中途黄仁勋被线缆卡住,反而是这场高浓度AI发布会里最有人味的片段,在当今基本提前彩排或录播的科技发布会里已经很稀缺了。

刚刚,黄仁勋再次发布了全新一代核弹级AI芯片,不过这场发布会的还有个隐藏主角——DeepSeek。

由于智能体AI(Agentic AI)和推理能力的提升,现在所需的计算量至少是去年此时预估的100倍。

推理成本效率给AI行业带来影响,而不是简单地堆积计算能力,成为贯穿这场发布会的主线。英伟达要变成AI工厂,让AI以超越人类的速度学习和推理。

推理本质上是一座工厂在生产token,而工厂的价值取决于能否创造收入和利润。因此,这座工厂必须以极致的效率打造。

黄仁勋掏出的英伟达新「核弹」也在告诉我们,未来的人工智能竞争不在于谁的模型更大,而在于谁的模型具有最低的推理成本和更高推理的效率。

除了全新Blackwell 芯片,还有两款「真·AI PC」

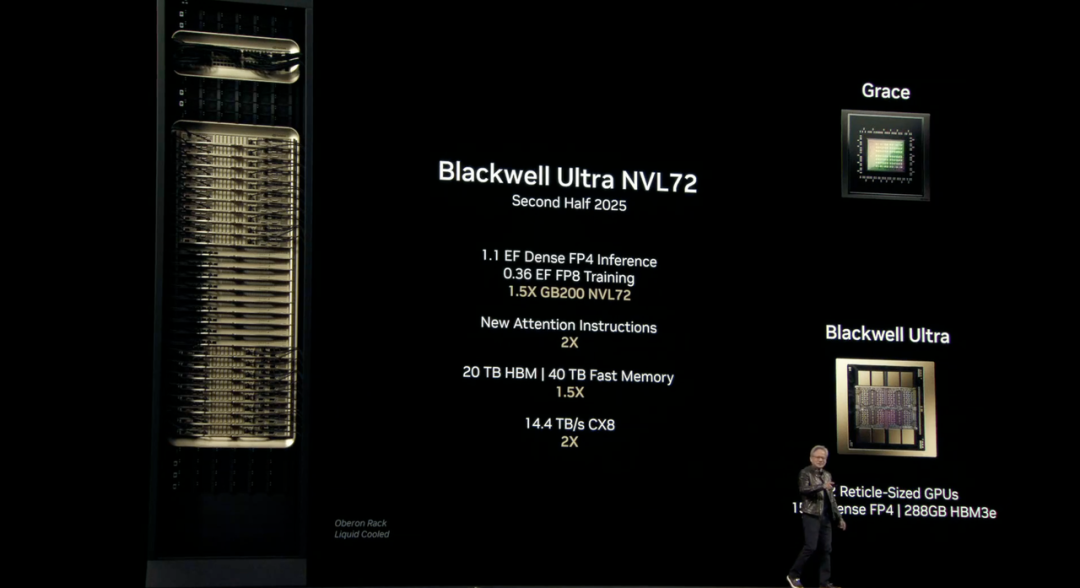

全新的Blackwell芯片代号为「Ultra」,也就是GB300 AI芯片,接棒去年的「全球最强AI芯片」B200,再一次实现性能上的突破.

Blackwell Ultra将包括英伟达GB300 NVL72机架级解决方案,以及英伟达HGX B300 NVL16系统。

Blackwell Ultra GB300 NVL72将于今年下半年发布,参数细节如下:

1.1 EF FP4 Inference:在进行FP4精度的推理任务时,能够达到1.1 ExaFLOPS(每秒百亿亿次浮点运算)。

0.36 EF FP8 Training:在进行FP8精度的训练任务时,性能为1.2 ExaFLOPS。

1.5X GB300 NVL72:与GB200 NVL72相比,性能为1.5倍。

20 TB HBM3:配备了20TB HBM 内存,是前代的1.5倍

40 TB Fast Memory:拥有 40TB 的快速内存,是前代的 1.5 倍。

14.4 TB/s CX8:支持CX8,带宽为14.4 TB/s,是前代的2倍。

单个Blackwell Ultra芯片将和前代一样提供相同的20 petaflops(每秒千万亿次浮点运算) AI性能,但配备更多的288GB的HBM3e内存。

如果说H100更适合大规模模型训练,B200在推理任务中表现出色,那么B300则是一个多功能平台,预训练、后训练和AI推理都不在话下。

英伟达还特别指出,Blackwell Ultra也适用于AI智能体,以及用于训练机器人和汽车自动驾驶的「物理AI」。

为了进一步增强系统性能,Blackwell Ultra还将与英伟达的Spectrum-X以太网和英伟达Quantum-X800 InfiniBand平台集成,为系统中的每个GPU提供800Gb/s的数量吞吐量,帮助AI工厂和云数据中心能够更快处理AI推理模型。

除了NVL72机架,英伟达还推出了包含单个GB300 Blackwell Ultra芯片的台式电脑 DGX Station。Blackwell Ultra之外,这个主机还将配备784GB的同一系统内存,内置 800Gbps英伟达ConnectX-8 SuperNIC网络,能够支持20 petaflops的AI性能。

而之前在CES 2025展示的「迷你主机」Project DIGITS也正式被命名为DGX Spark,搭载专为桌面优化的GB10 Grace Blackwell超级芯片,每秒可提供高达1000万亿次 AI 计算操作,用于最新 AI 推理模型的微调和推理,包括NVIDIA Cosmos Reason世界基础模型和 NVIDIA GR00T N1机器人基础模型。

黄仁勋表示,借助 DGX Station 和 DGX Spark,用户可以在本地运行大模型,或者将其部署在 NVIDIA DGX Cloud 等其他加速云或者数据中心基础设施上。

这是AI时代的计算机。

DGX Spark系统现已开放预订,而DGX Station预计将由华硕、戴尔、惠普等合作伙伴于今年晚些时候推出。

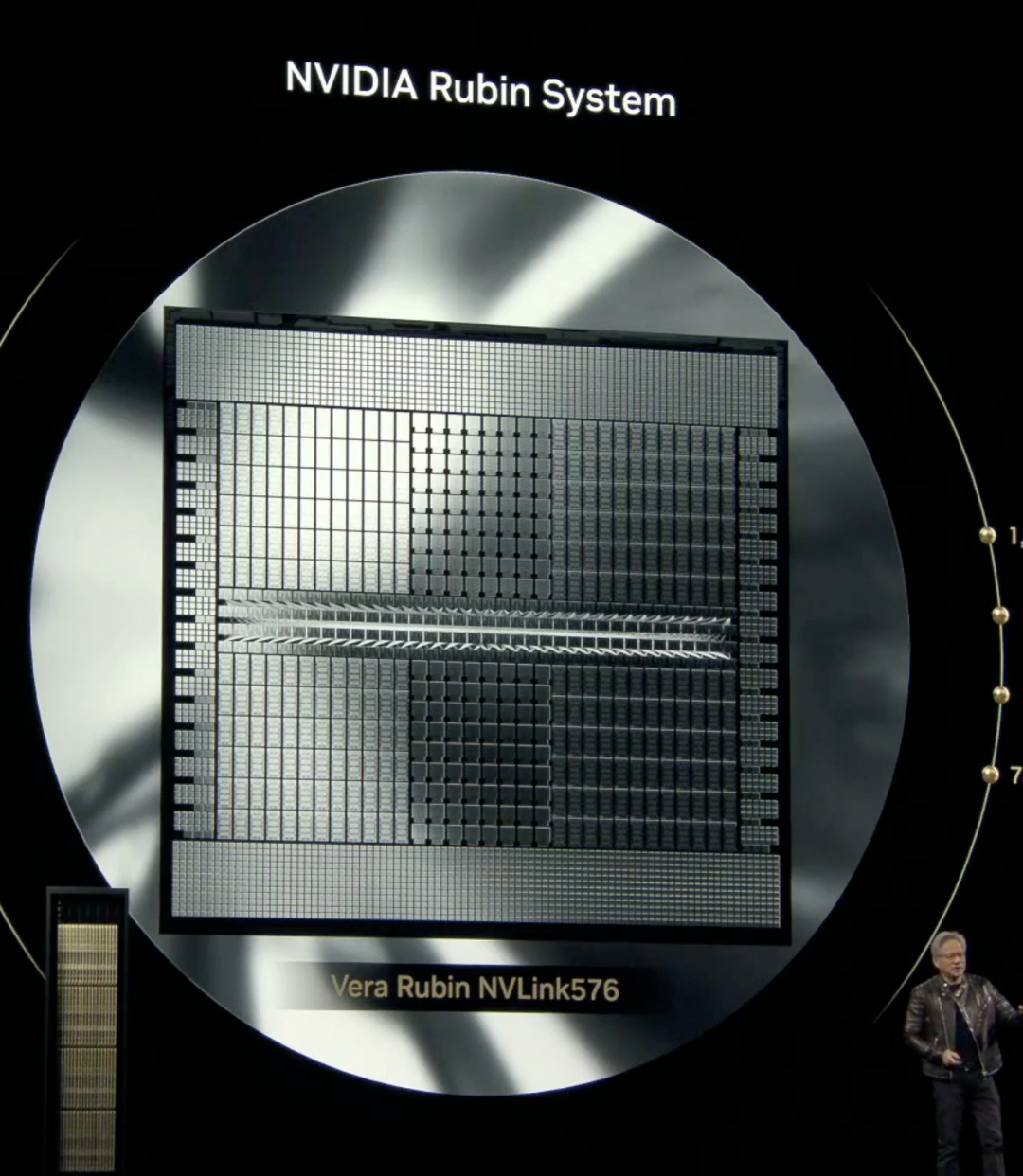

下一代 AI 芯片 Rubin 官宣,2026 年下半年推出

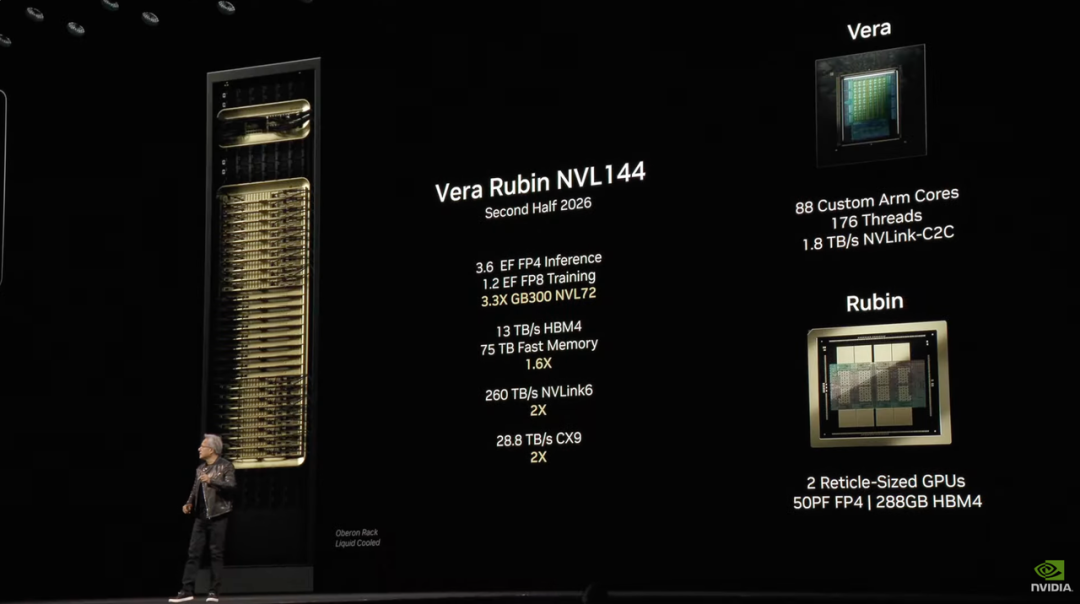

英伟达一直以科学家的名字为其架构命名,这种命名方式已成为英伟达文化的一部分。这一次,英伟达延续了这一惯例,将下一代 AI 芯片平台命名为「Vera Rubin」,以纪念美国著名天文学家薇拉·鲁宾(Vera Rubin)。

黄仁勋表示,Rubin 的性能将达到 Hopper 的 900 倍,而 Blackwell 相较 Hopper 已实现了 68 倍的提升。

其中,Vera Rubin NVL144 预计将在 2026 年下半年发布。参数信息省流不看版:

3.6 EF FP4 Inference:在进行 FP4 精度的推理任务时,能够达到 3.6 ExaFLOPS(每秒百亿亿次浮点运算)。

1.2 EF FP8 Training:在进行 FP8 精度的训练任务时,性能为 1.2 ExaFLOPS。

3.3X GB300 NVL72:与 GB300 NVL72 相比,性能提升了 3.3 倍。

13 TB/s HBM4:配备了 HBM4,带宽为 13TB/s。

75 TB Fast Memory:拥有 75 TB 的快速内存,是前代的 1.6 倍。

260 TB/s NVLink6:支持 NVLink 6,带宽为 260 TB/s,是前代的 2 倍。

28.8 TB/s CX9:支持 CX9,带宽为 28.8 TB/s,是前代的 2 倍。

标准版 Rubin 将配备 HBM4,性能比当前的 Hopper H100 芯片大幅提升。

Rubin 引入名为 Grace CPU 的继任者——Veru,包含 88 个定制的 Arm 核心,每个核心支持 176 个线程,并通过 NVLink-C2C 实现 1.8 TB/s 的高带宽连接。

英伟达表示,定制的 Vera 设计将比去年 Grace Blackwell 芯片中使用的 CPU 速度提升一倍。

与 Vera CPU 搭配时,Rubin 在推理任务中的算力可达 50 petaflops,是 Blackwell 20 petaflops 的两倍以上。此外,Rubin 还支持高达 288GB 的 HBM4 内存,这也是 AI 开发者关注的核心规格之一。

实际上,Rubin 由两个 GPU 组成,而这一设计理念与当前市场上的 Blackwell GPU 类似——后者也是通过将两个独立芯片组装为一个整体运行。

从 Rubin 开始,英伟达将不再像对待 Blackwell 那样把多 GPU 组件称为单一 GPU,而是更准确地按照实际的 GPU芯 片裸片数量来计数。

互联技术也升级了,Rubin 配备第六代 NVLink,以及支持 1600 Gb/s 的 CX9 网卡,能够加速数据传输并提升连接性。

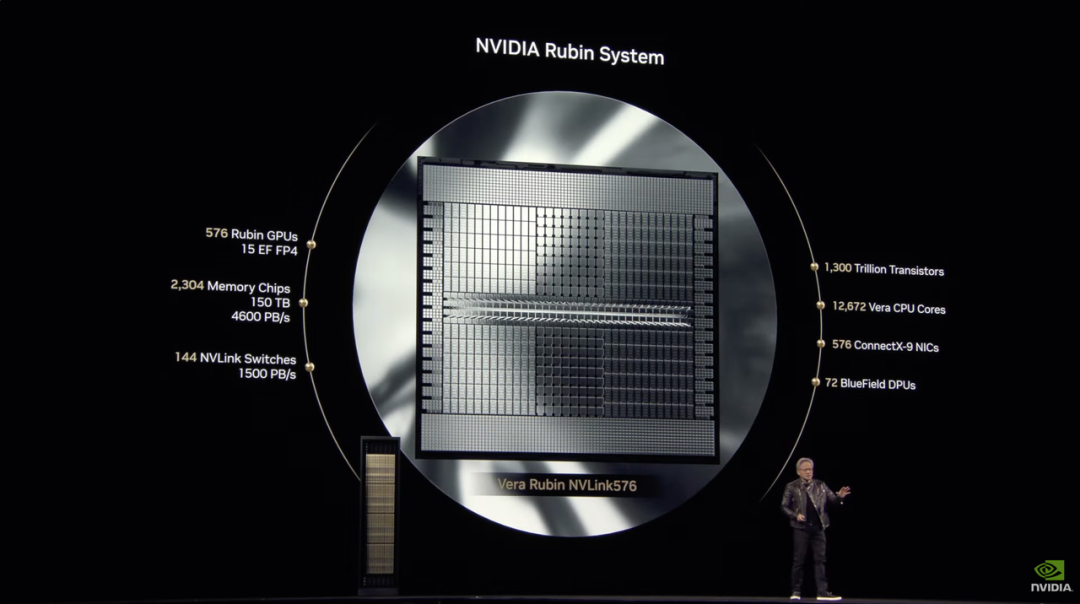

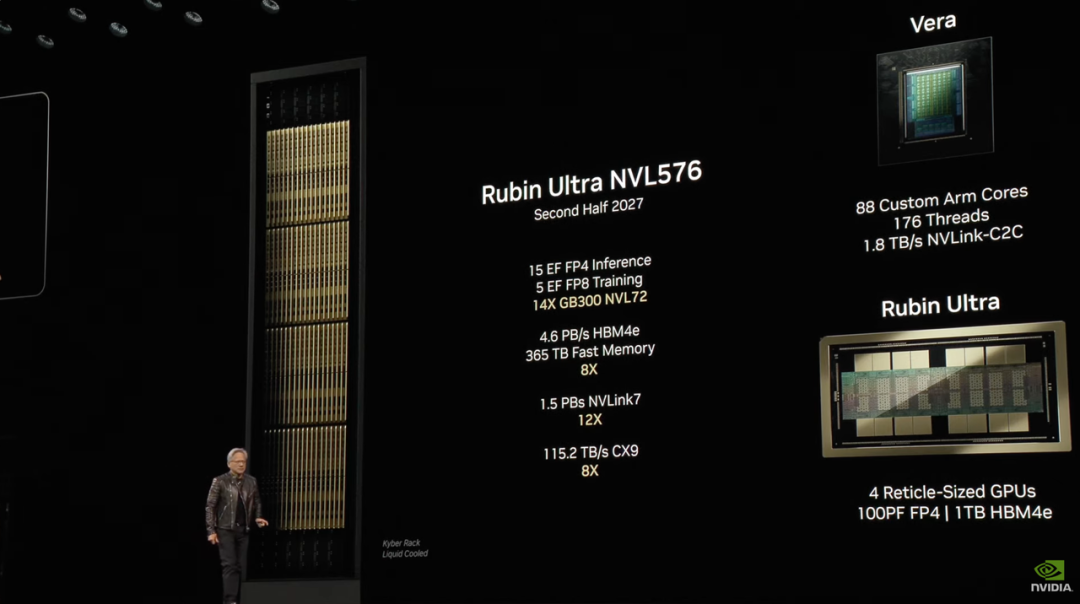

除了标准版 Rubin,英伟达还计划推出 Rubin Ultra 版本。

Rubin Ultra NVL576 则将于 2027 年下半年推出。参数细节如下:

15 EF FP4 Inference:在 FP4 精度下进行推理任务时,性能达到 15 ExaFLOPS。

5 EF FP8 Training:在 FP8 精度下进行训练任务时,性能为 5 ExaFLOPS。

14X GB300 NVL72:相比 GB300 NVL72,性能提升 14 倍。

4.6 PB/s HBM4e:配备 HBM4e 内存,带宽为 4.6 PB/s。

365 TB Fast Memory:系统拥有 365 TB 的快速内存,是前代的 8 倍。

1.5 PB/s NVLink7:支持 NVLink 7,带宽为 1.5 PB/s,是前代的 12 倍。

115.2 TB/s CX9:支持 CX9,带宽为 115.2 TB/s,是前代的 8 倍。

在硬件配置上,Rubin Ultra 的 Veras 系统延续了 88 个定制 Arm 核心的设计,每个核心支持 176 个线程,并通过 NVLink-C2C 提供 1.8 TB/s 的带宽。

而 GPU 方面,Rubin Ultra 集成了 4 个 Reticle-Sized GPU,每颗 GPU 提供 100 petaflops 的 FP4 计算能力,并配备 1TB 的 HBM4e 内存,在性能和内存容量上都达到了新的高度。

为了在瞬息万变的市场竞争中站稳脚跟,英伟达的产品发布节奏已经缩短至一年一更。发布会上,老黄也正式揭晓下一代 AI 芯片的命名——物理学家费曼(Feynman)。

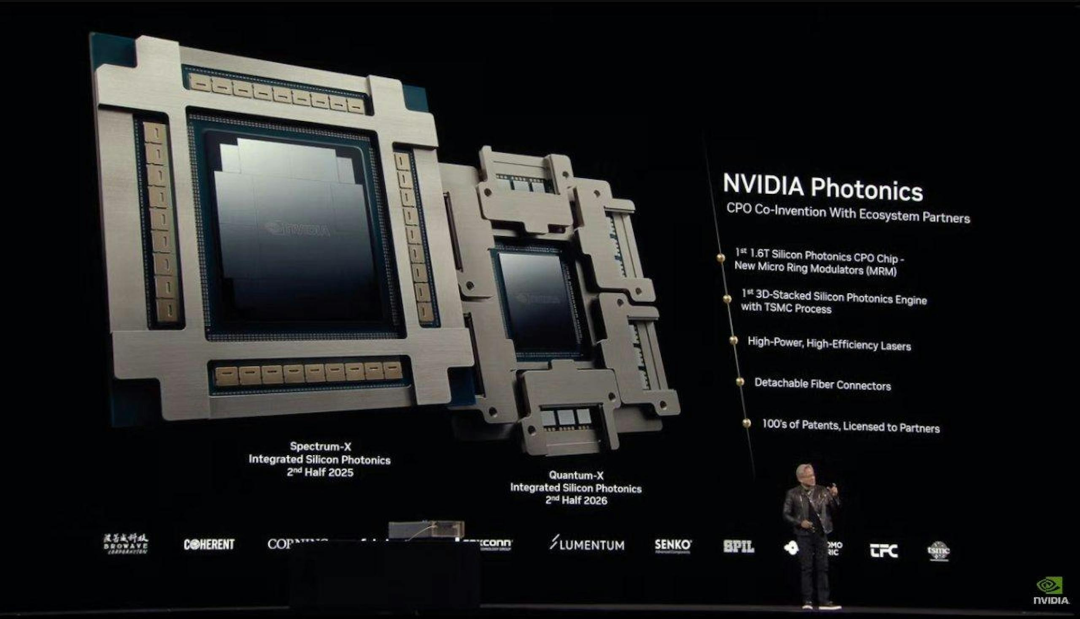

随着 AI 工厂的规模不断扩大,网络基础设施的重要性愈发凸显。

为此,英伟达推出了 Spectrum-X™ 和 Quantum-X 硅光网络交换机,旨在帮助 AI 工厂实现跨站点连接数百万 GPU,同时显著降低能耗和运营成本。

Spectrum-X Photonics 交换机具有多种配置,包括:

128 端口 800Gb/s或 512 端口 200Gb/s 配置,总带宽达 100Tb/s

512 端口 800Gb/s或 2048 端口200Gb/s配置,总吞吐量达 400Tb/s

与之配套的 Quantum-X Photonics 交换机则基于 200Gb/s SerDes 技术,提供 144 端口 800Gb/s 的 InfiniBand 连接,并采用液冷设计高效冷却板载硅光子组件

与上一代产品相比,Quantum-X Photonics 交换机为 AI 计算架构提供 2 倍速度和 5 倍可扩展性。

Quantum-X Photonics InfiniBand 交换机预计于今年晚些时候上市,而 Spectrum-X Photonics 以太网交换机预计将于 2026 年推出。

随着 AI 的快速发展,对数据中心的带宽、低延迟和高能效需求也急剧增加。

英伟达 Spectrum-X Photonics 交换机采用了一种名为 CPO 的光电子集成技术。其核心是将光引擎(就是能处理光信号的芯片)和普通的电子芯片(比如交换芯片或 ASIC 芯片)放在同一个封装里。

这种技术的好处很多:

传输效率更高:因为距离缩短,信号传输更快。

功耗更低:距离短了,传输信号需要的能量也少了。

体积更小:把光和电的部件集成在一起,整体体积也变小了,空间利用率更高。

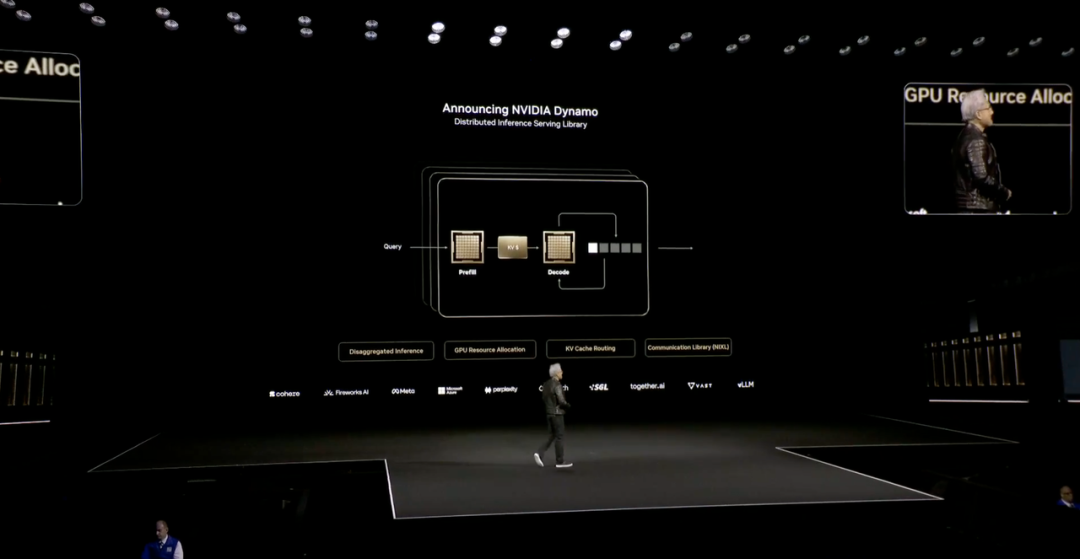

AI 工厂的「操作系统」Dynamo

未来将没有数据中心,只有 AI 工厂。

黄仁勋表示,未来,每个行业、每家公司拥有工厂时,都将有两个工厂:一个是他们实际生产的工厂,另一个是 AI 工厂,而 Dynamo 则是专门为「AI 工厂」打造的操作系统。

Dynamo是一款分布式推理服务库,为需要token但又无法获得足够token的问题提供开源解决方案。

简单来说,Dynamo有四个方面的优势:

GPU规划引擎,动态调度GPU资源以适应用户需求

智能路由器,减少GPU对重复和重叠请求的重新计算,释放更多算力应对新的传入请求

低延迟通信库,加速数据传输

内存管理器,智能在低成本内存和存储设备中的推理数据

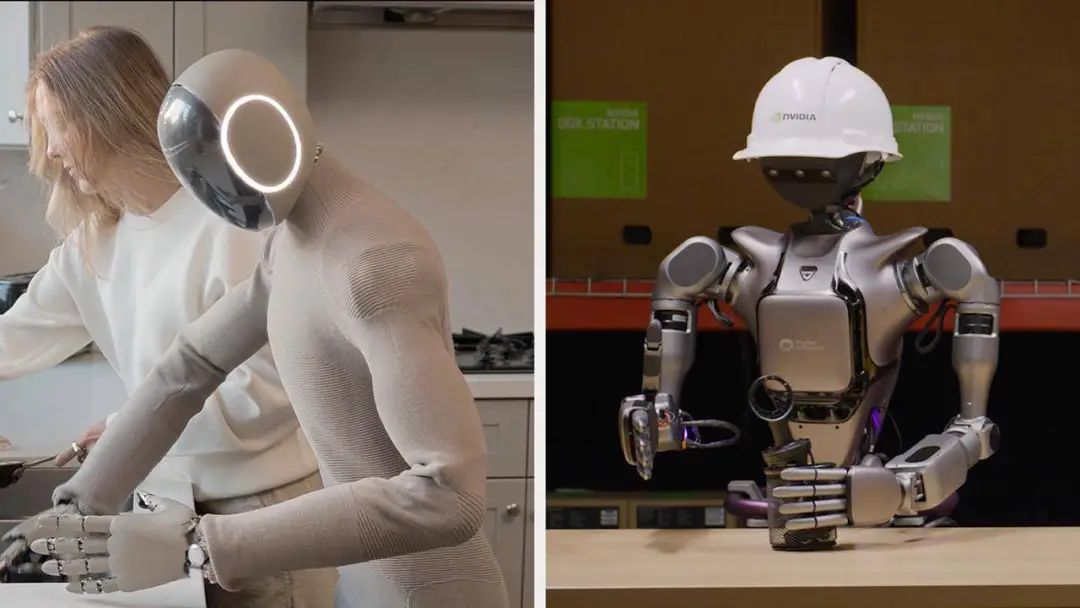

人形机器人的露脸环节,永远不会缺席

人形机器人再一次成为了GTC大会的压轴节目,这次英伟达带来了Isaac GR00T N1,全球首款开源人形机器人功能模型。

黄仁勋表示,通用机器人技术的时代已经到来,借助Isaac GR00T N1核心的数据生成以及机器人学习框架,全球各地的机器人开发人员将进入AI时代的下一个前沿领域。

这个模型采用「双系统」架构,模仿人类的认知原理:

系统 1:快速思考的动作模型,模仿人类的反应或直觉

系统 2:慢思考的模型,用于深思熟虑的决策。

在视觉语言模型的支持下,系统 2 对环境和指令进行推理,然后规划动作,系统 1 将这些规划转化为机器人的的动作。

GR00T N1的基础模型采用广义类人推理和技能进行了预训练,而开发人员可以通过真实或合成数据进行后训练,满足特定的需求:既可以完成工厂的特定任务,也可以在家里自主完成家务。

黄仁勋还宣布了与Google DeepMind和Disney Research合作开发的开源物理引擎 Newton。

一台搭载Newton平台的机器人也登上了舞台,黄仁勋称之为「Blue」,外观神似《星球大战》中的BDX机器人,能够用声音和动作和黄仁勋互动。

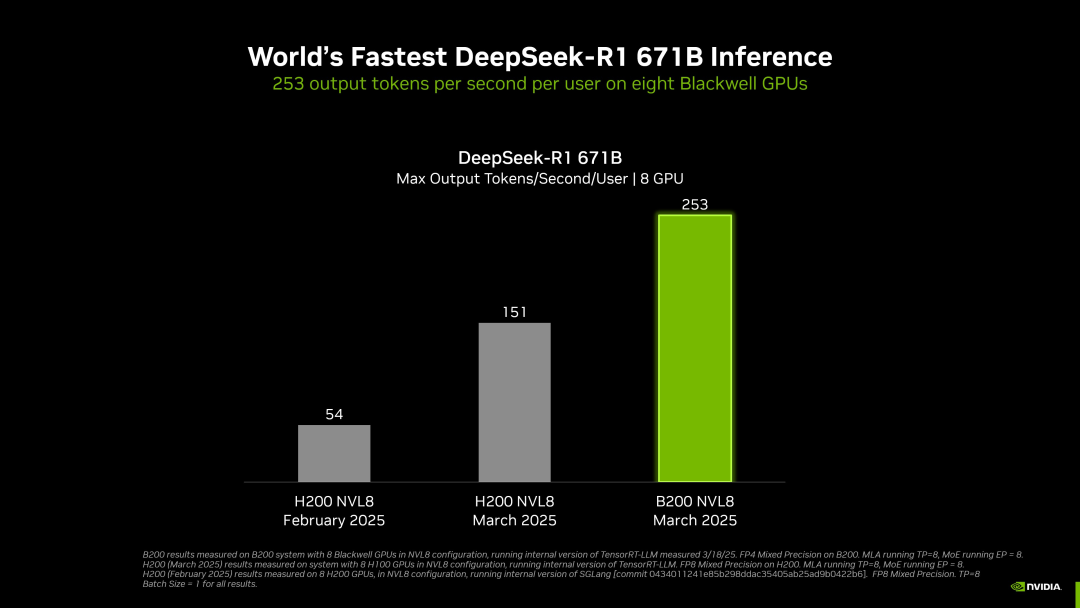

8块GPU,DeepSeek-R1推理速度创全球之最

英伟达实现了全球最快的DeepSeek-R1推理。

官网显示,一台搭载8个Blackwell GPU的DGX系统,在运行 6710 亿参数的 DeepSeek-R1模型时,可实现每用户每秒超过 250 个 token 的速度,或达到最高吞吐量每秒超过30000个token。

通过硬件和软件的结合,自今年1月以来,英伟达在DeepSeek-R1 671B模型上的吞吐量提升了约36倍,每token的成本效率提高了约32倍。

为了实现这一成就,英伟达完整的推理生态系统已针对Blackwell架构进行了深度优化,不仅整合TensorRT-LLM、TensorRT Model Optimizer等先进工具,还无缝支持 PyTorch、JAX和TensorFlow等主流框架。

在 DeepSeek-R1、Llama 3.1 405B 和 Llama 3.3 70B 等模型上,采用 FP4 精度的 DGX B200 平台相较于 DGX H200 平台,推理吞吐量提升超过 3 倍。

值得注意的是,此次发布会的主题演讲并未提及量子计算,但英伟达特意在这届GTC大会设置了量子日,邀请了多家当红量子计算公司的CEO出席。

要知道黄仁勋年初一句「量子计算还需20年才实用」的论断犹在耳畔。

一改口风的背后,离不开微软耗时17年研发的拓扑量子芯片Majorana 1实现8个拓扑量子比特集成,离不开Google Willow芯片宣称用5分钟完成经典计算机需10^25年处理的任务,推动了量子计算的热潮。

芯片无疑是重头戏,但一些软件的亮相同样值得关注。

硅谷著名投资人马克·安德森曾提出软件正在吞噬世界(Software is eating the world)的论断,其核心逻辑在于软件通过虚拟化、抽象化和标准化,正在成为控制物理世界的基础设施。

不满足于做「卖铲人」,英伟达的野心是打造AI时代的「生产力操作系统」。从汽车智能驾驶,到制造业的数字孪生工厂,这些贯穿整场发布会的案例都是将 GPU 算力转化为行业生产力的具象化表达。

实际上,无论是发布会上亮相的最新核弹芯片,还是押注战未来的量子计算,黄仁勋在这场发布会上对AI未来发展的洞察和布局,都比当下的技术参数与性能指标更具看点。

在介绍 Blackwell与Hopper架构的对比时,黄仁勋还不忘幽默一把。

他以一个100MW工厂的对比数据为例,指出采用Hopper架构需要45,000颗芯片和400个机架,而Blackwell架构凭借更高的效率显著减少了硬件需求。

于是,黄仁勋那句经典的总结再次抛出,「the more you buy, the more you save」(买得越多,省得越多)。」随后话锋一转,他又补充说,「the more you buy, the more you make」(买得越多,赚得越多)。

随着AI领域的重心从训练转向推理,英伟达更需要证明其软硬件生态在推理场景的不可替代性。

一方面,Meta、Google等巨头自研AI芯片,可能分流GPU市场需求。

另一方面,英伟达最新AI芯片的适时亮相,回应如 DeepSeek 的开源模型对 GPU 需求的冲击,并展示推理领域技术优势,也是为了对冲市场对训练需求见顶的担忧。

最近估值(未来12月市盈率)跌至10年低位的英伟达,比以往任何时候都需要一场酣畅淋漓的胜利。