全文2112字,阅读时间约7分钟

最近因为访问量过大、服务器过载、被网络攻击等因素的影响,导致使用DeepSeek的时候经常出现“加载失败”“服务器繁忙,请稍后再试”等等错误信息。

像我这种刷了N次都没有响应的是大多数,如下图中显示的。

图片来源:DeepSeek网页版

即使你幸运地“刷出”了响应,答案可能也是残缺的、不完整的,或者没有经过深思熟虑的。于是,这一轮的投入产出比变成了0,花了时间和情绪价值(满满的期待),却没有得到想要的答案,很郁闷!

有人可能说,干脆在自己笔记本上部署一个DeepSeek吧,不是开源模型嘛,而且好像也花不了多少钱。

嗯,我个人是不建议自己部署模型的,虽然我也曾经有过这样的想法。关于这点我计划后续写一篇文章专门说说。

那DeepSeek不响应了怎么办?下面我分享6个DeepSeek的“备胎”——它们都接入了DeepSeek大模型,既有“满血版”,也有“简约版”(蒸馏版)。

话不多说,先上答案。其中,1-4个适用于国内用户,5-6适用于国外用户。你是小白也没关系,不用配置,直接用!

图片来源:卢山评测整理

01 纳米AI搜索

图片来源:纳米AI搜索APP版

使用方法:在应用商店搜索「纳米 AI」APP下载安装,注册账号后,在首页右下角 “AI 机器人” 一栏即可找到 DeepSeek。可选择 “深度模式” 调用满血版模型,输入问题时勾选 “深入回答”,能让满血版的 R1 基于基础答案和搜索来的参考资料进行总结思考。

易用性:支持网页和APP,注册流程简单,APP版本更便捷。

使用体验:提供32B和671B两种版本。上手门槛低,会为用户提供参考提问、联想提问以及追加提问。支持文字、音频、视频等多模态输入与输出方式,还支持拍照一键搜索功能。

输出答案速度:响应速度快,高峰时段零排队。

输出答案质量:接入的满血版 R1 模型可以很好地保留人设和写作风格,回答质量较高,结合联网功能,能基于搜索资料进行总结思考,给出更全面的答案,但需消耗积分。

适用场景:适合移动端用户,尤其是对速度要求较高的用户。

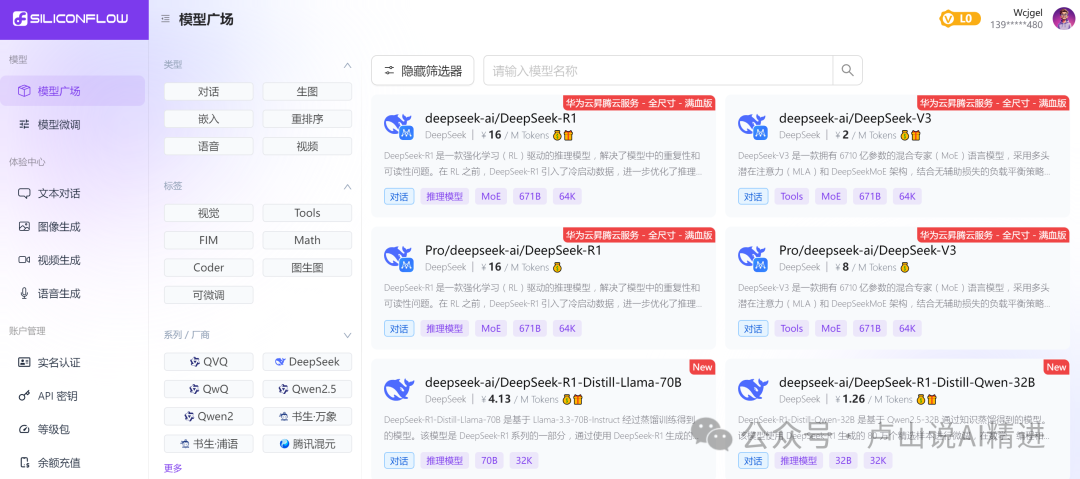

02 硅基流动

图片来源:硅基流动网页版

使用方法:访问官网注册后(https://cloud.siliconflow.cn/),可直接打开 DeepSeek R1 模型体验,也可获取 API 密钥后与 Chatbox AI 组合使用,在 Chatbox AI 中选择相应的 DeepSeek 模型即可。

易用性:注册后直接使用,支持API开发。

使用体验:专业的 AI 模型服务商,功能完整,稳定性高,完全免费。界面操作较为便捷,组合使用时还能保留聊天记录和上传附件。

输出答案速度:通常能快速响应,在处理复杂任务时也有不错的表现。

输出答案质量:提供 R1、V3 满血版以及 DS 多尺寸模型,回答质量高,能很好地完成各种文本任务,但在线使用时无法使用 DS 的联网功能。

适用场景:适合需要API开发和全国产解决方案的用户。

03 秘塔AI搜索

图片来源:秘塔AI搜索网页版

使用方法:打开网页(https://metaso.cn/ )或 APP,选择 “长思考 - R1” 模式即可使用 DeepSeek-R1 模型,无需注册、付费或技术门槛。有简洁、深入、研究三种模式,可满足不同需求。

易用性:网页版操作简单,但联网功能无法关闭。

使用体验:支持文本、图像、语音等多模态输入,能跨语言搜索,针对专业领域有深度优化,还可智能摘要与推理,提供个性化推荐。支持联网搜索,适合需要实时信息的用户。

输出答案速度:借助其强大的联网检索能力和与 DeepSeek-R1 的融合,响应速度较快,能快速整合信息给出答案。

输出答案质量:“R1 模型 + 全网实时搜索 + 学术文献库” 的组合,使回答全面、权威、准确,可用于日常查询、撰写论文或商业报告等各种场景。

适用场景:适合需要联网搜索功能的用户。

04 超算互联网

图片来源:超算互联网网页版

使用方法:直接登录超算互联网平台(https://www.scnet.cn )即可使用。

易用性:需要一定的技术知识,适合企业级用户。

使用体验:由科技部牵头,平台可靠性有保障,使用较为稳定。

输出答案速度:在处理基本任务时速度尚可,但因提供的是蒸馏版模型,运算量相对较小,整体速度不算突出。

输出答案质量:提供的是 7B、14B 和 32B 的蒸馏版模型,能满足一些基本的使用需求,但相比满血版,在语义理解和复杂任务处理上稍逊一筹。

适用场景:适合企业级用户和需要大模型支持的用户。

05 Lambda Chat

使用方法:访问网址(https://lambda.chat/)即可使用,但需要特定网络条件,通常需要使用能访问该网站的网络工具。

易用性:无需注册,直接使用。

使用体验:响应速度快,适合海外用户。

输出答案速度:响应速度较快。

输出答案质量:质量一般,适合简单对话。

适用场景:适合海外用户或对注册流程敏感的用户。

06 Poe

使用方法:登录 Poe 平台(https://poe.com/ )即可使用其提供的 Deepseek - R1 模型。

易用性:注册流程简单,支持邮箱、苹果账号等登录,网页版和移动端应用。

使用体验:“北美知乎” Quora 旗下的 AI 聊天平台,界面友好,支持多设备同步,提供多种AI模型。

输出答案速度:响应速度快,支持实时交互。

输出答案质量:提供的 Deepseek - R1 模型上下文可达 164k,最大输出 33k,性能出色,答案质量较高。

适用场景:适合需要多模型集成、多场景应用的用户。

07 总结

如果你更注重速度和便捷性,纳米AI搜索是最佳选择,尤其是其APP版本。

如果你需要API开发或全国产解决方案,硅基流动是不错的选择。

如果你需要联网搜索功能,秘塔AI搜索更适合。

对于企业级用户或需要大模型支持的用户,超算互联网是一个可靠的选择。

如果你是海外用户或希望快速体验,Lambda Chat是一个简单且免费的平台。

如果你需要多模型集成和多场景应用,Poe是一个功能强大的平台,支持多种AI模型。

好了,上述6个备胎,总有一款适合你。也欢迎留言反馈和建议。

作者 | 卢山 LUCENT LU ; 编辑 | 呼呼大睡