编译 | 尹明顺

编辑 | 漠影

智东西9月14日消息,据VentureBeat昨日报道,微软公布了一项名为“Windows Agent Arena(WAA)”的开创性基准测试。该测试用于在Windows操作环境中对AI Agent性能进行评估,旨在为AI Agent开发提速。

该论文发表在arXiv.org上。研究人员写道:“大语言模型在AI Agent领域显示出巨大的潜力,能够在需要规划和推理的多模态任务中提升人类生产力和软件的可用性。”同时还补充道:“然而,在真实环境中衡量AI Agent性能依然是一个挑战。”

WAA的创新点在于,它能够在微软Azure云科技中的多个虚拟机上进行并行测试,在短短20分钟内就可完成全面的基准评估。

此外,微软还将多模态AI Agent Navi引入测试,以展示WAA的能力。经检验,Navi在WAA测试中任务完成的成功率为19.5%,而人类的成功率是74.5%。

▲Windows Agent Arena(来源:Windows Agent Arena页面)

一、涵盖154项任务测试,全面基准评估时长缩短至20分钟

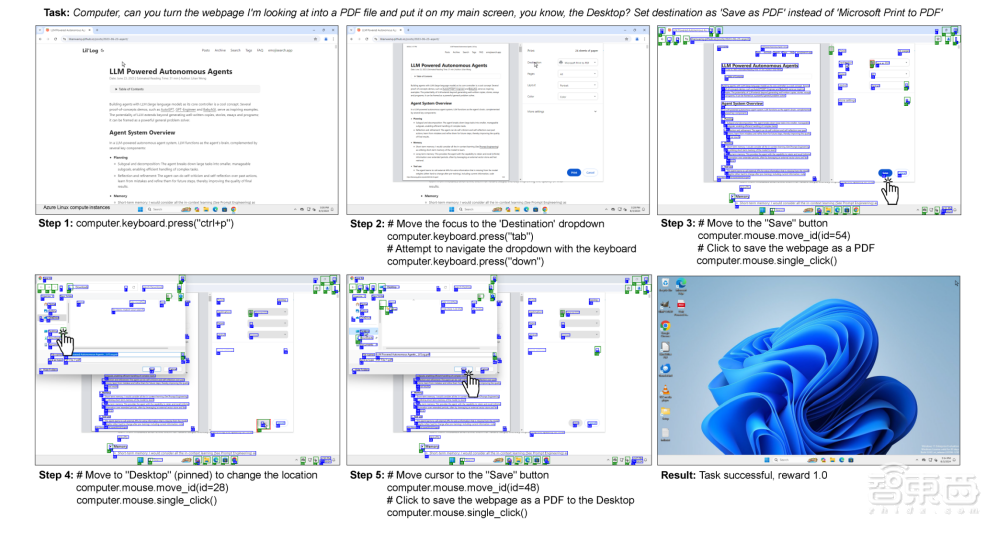

Windows Agent Arena提供了一个可复现测试环境,其中AI Agent与常见的Windows应用程序、网络浏览器和系统工具进行交互,模拟人类用户体验,继而帮助开发者评估和优化AI Agent的能力。

微软的研究人员写道,在真实环境中测试Agent性能仍然是一个挑战,这是因为大多数基准测试仅限于特定模式或领域(例如,纯文本、Web导航、问答、编码);另外鉴于任务的多步骤顺序性质,完整的基准评估很慢(大约几天时间)。

WAA的一个关键创新是能够在微软Azure云科技中的多个虚拟机上进行并行测试。论文解释称:“我们的基准测试是可扩展的,可以在Azure中无缝并行处理,在短短20分钟内就可完成全面的基准评估。”与传统可能需要数天的顺序测试相比,这极大地加快了AI Agent开发周期。

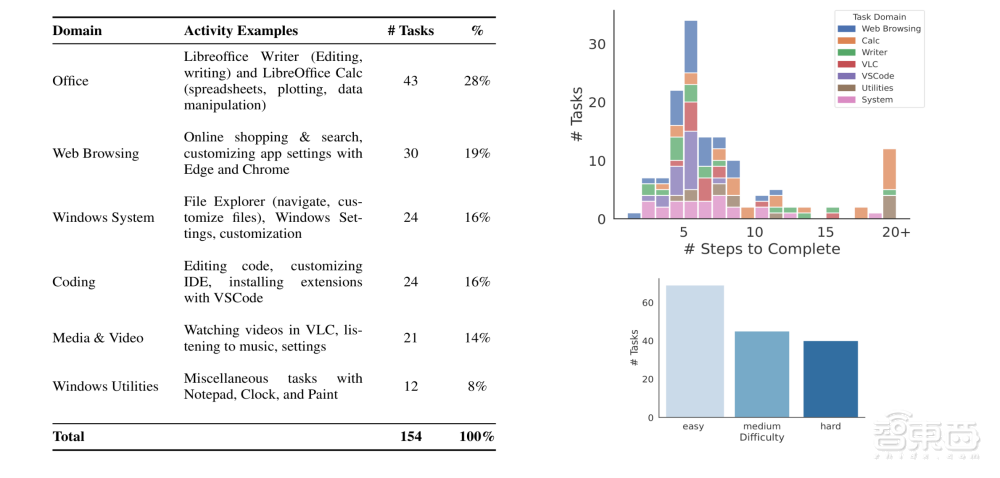

该测试包含了154个不同任务,涵盖编辑文档和电子表格(LibreOffice Calc/Writer)、浏览互联网(微软Edge、Google Chrome)、Windows系统任务(文件资源管理器、设置)、编码(Visual Studio Code)、观看视频(VLC播放器)和实用功能(记事本、时钟、画图)。

▲涵盖的测试具体任务显示(图源:Windows Agent Arena页面)

二、测试AI Agent任务成功率仅19.5%,远低于人类操作能力

Windows Agent Arena项目页面显示:“为了展示WAA的能力,我们还引入了一种新的多模态AI Agent Navi。”