近年来,视频游戏开发者和计算机科学家一直在尝试开发一些全新的技术,让玩家能够拥有更加逼真、引人入胜的沉浸式游戏体验,这些方法中就包括自动创建以真人为原型的电子游戏角色。

而现有的创建和定制电子游戏角色的方法,大都需要手动调整角色的面部特征,以便重新创建自己或其他人的脸。除此之外,一些开发者还试图开发一种方法,通过分析真人的面部图像,来自动生成定制化的游戏角色。然而,这些方法几乎都尚不完善,不但效果难以得到保证,而且很难做到以现实的方式重现其分析的面孔。

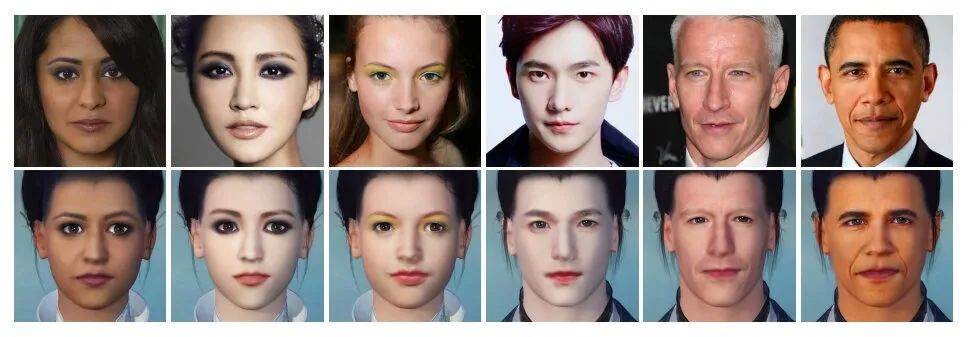

图 | 输入肖像与生成的游戏角色(来源:arXiv.org)

网易伏羲人工智能实验室和密歇根大学的研究人员最近开发出一种深度学习技术 MeInGame,可以通过分析单个人脸照片自动生成游戏角色的面孔,做到与真实的人脸非常接近。

该研究成果于今年 2 月在预印本平台 arXiv.org 发表,标题为《MeInGame:用一张肖像创建游戏角色》(MeInGame:Create a Game Character Face from a Single Portrait)。

开展这项研究的科研人员表示,“我们提出的这种自动的角色人脸创建方法,可以预测出单个人像的面部形状和纹理,并可以集成到大多数现有的 3D 游戏中。”

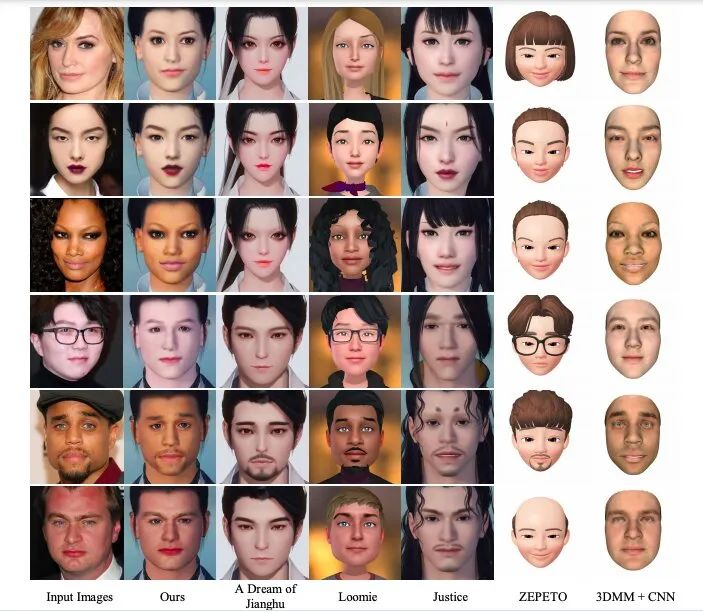

据悉,此前的一些自动角色定制系统主要是基于 3D 变形脸模型(3DMMs)计算技术来生成作品。虽然其中不乏有一些方法可以比较精确地复制人脸特征,但这些方法表示几何属性和空间关系(即拓扑)的方式通常与大多数 3D 电子游戏中使用的网格存在差异。

图 | 不同方法生成图像的对比图,最后一列为基于 3DMM 方法的结果(来源:arXiv.org)

一般而言,只有经过大型图像数据集以及纹理数据的训练,3DMMs 才能做到再现人脸的纹理,而编译这些数据集则需要耗费大量的时间。而且,这些数据集并不能把自然场景下收集的真实图像全部涵盖进去,这样一来,可能会使其训练的模型在呈现新数据时,无法拥有持续良好的表现。

为了克服这一难题,该研究团队选择直接在自然场景下的图像数据集上,对他们的技术进行技术。

此外,他们还创新性地提出了 3 大技术方法:低成本的人脸纹理获取方法,将三维网格的形状转换为游戏形状的传递算法以及一种新的训练三维游戏人脸重建网络的管道。

“给定一张待输入的人脸照片,我们首先根据 3D 变形人脸模型(3DMM)和卷积神经网络(CNNs)重建一张 3D 人脸,然后将 3D 人脸的形状转移到模板网格中。该网络以人脸照片和去包裹的粗 UV 纹理图作为输入值,然后预测出光照系数和细化纹理图。” 研究人员解释道。

经过系列实验的评估,并将其开发的深度学习技术生成的游戏角色与其他现有的方法生成的角色面孔进行对比,发现他们研发的方法表现优异,能够生成与输入图像非常相似的角色面孔。

在这篇论文中,研究人员指出,他们所提出的方法不仅可以生成与输入画像相似且生动的游戏角色,而且还可以消除光线变化、阴影和遮挡对图像产生的影响,忠实地还原人像个性化的细节,如肤色、妆容和皱纹等。

“实验表明,我们的方法优于现有游戏中使用的最先进的方法。” 研究人员表示。

目前,MeInGame 模型的代码和用于训练它的数据集已经发布在网上,全世界的游戏开发者都可以通过 github.com 访问该模型。